Herramientas de usuario

Barra lateral

Tabla de Contenidos

**¡Esta es una revisión vieja del documento!**

Espacio [IA] Inteligencia Artificial

Teorías

Existen dos paradigmas teóricos sobre las redes neuronales

Redes Neuronales Produndas

LLamadas Deep Neural Networks, DNNs, o Deep Learning

redes neuronales profundas con muchas capas y millones de conexiones y que son entrenadas mediante el proceso denominado Stochastic Gradient Descent (SDG)

Algoritmos Evolutivos

Los algoritmos evolutivos constituyen un campo de investigación que incluye:

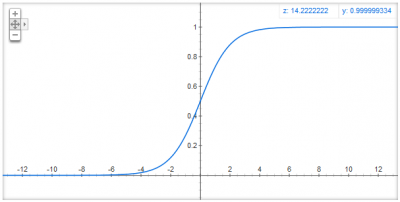

Red neuronal (NN)

A partir de la metodología se identifica el número de variables de entrada (neuronas de entrada) y las respuestas que se quieren obtener para las distintas combinaciones de las variables de entrada.

Las opciones son: considerar toda la metodología como una NN o considerar el salto entre actos/escenas como un proceso decisorio susceptible de ser modelado como NN.

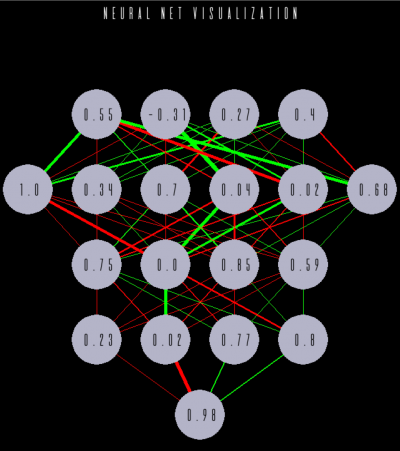

Topologías

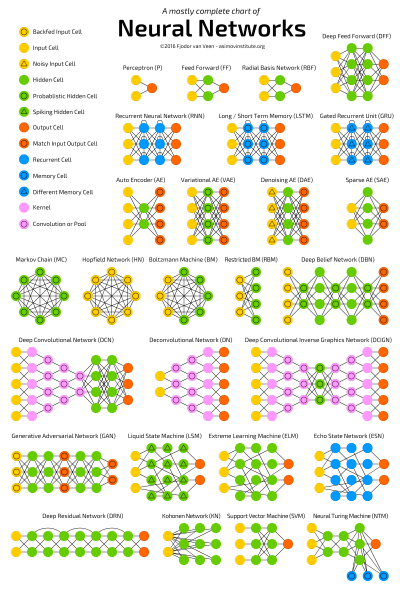

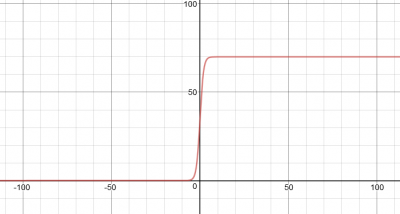

Función de activación

En redes computacionales, la Función de Activación de un nodo define la salida de un nodo dada una entrada o un conjunto de entradas. Se podría decir que un circuito estándar de computador se comporta como una red digital de funciones de activación al activarse como “ON” (1) u “OFF” (0), dependiendo de la entrada. Esto es similar al funcionamiento de un Perceptrón en una Red neuronal artificial.

— https://es.wikipedia.org/wiki/Funci%C3%B3n_de_activaci%C3%B3n

Neurona sigmoidal

Neurona lineal

Entrenamiento de una red neuronal

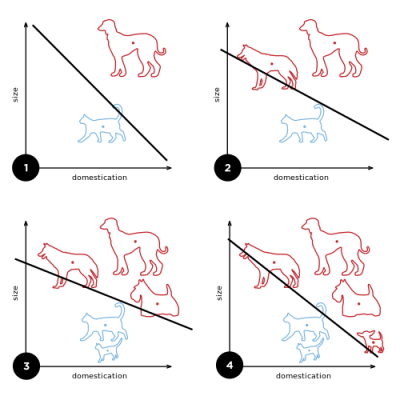

Supervisado

Con vistas al entrenamiento supervisado de la red neural que desarrollamos hay que elaborar un conjunto de datos de entrenamiento procedentes de datos reales.

No supervisado

Al ser un software conversacional hay que identificar qué interacciones suponen un refuerzo positivo y un refuerzo negativo a las respuestas proporcionadas por la NN.

Algoritmo de back-propagation

Recursos

Open Courseware. Prof. Patrick H. Winston

This course introduces students to the basic knowledge representation, problem solving, and learning methods of artificial intelligence. Upon completion of 6.034, students should be able to develop intelligent systems by assembling solutions to concrete computational problems; understand the role of knowledge representation, problem solving, and learning in intelligent-system engineering; and appreciate the role of problem solving, vision, and language in understanding human intelligence from a computational perspective.

| As Taught In | Fall 2010 |

|---|---|

| Level | Undergraduate |

Argumentación en IA

Libro de Rahwan & Simari (eds) Argumentation in Artificial Inteligence, Springer2009

Aspectos básicos de la IA

Libro de Mira, Delgado, Boticario y Díez, Aspectos básicos de la Inteligencia Artificial, UNED, ed Sanz y Torres, 1995, reimpresión 2003.

Programación

OpenBSD

En OpenBSD pueden cargarse los siguientes packages

| fann-2.1 | Fast Artificial Neural Network Library |

|---|---|

| p5-AI-FANN | interface to the Fast Artificial Neural Network library |

source{d}

Existe una iniciativa para crear componentes de fuente abierta para aplicar la inteligencia artificial al desarrollo de software. El proyecto se llama source{d} y, en palabras del exingeniero de Google que se ha unido al proyecto:

"Machine Learning will revolutionize how we analyze programs. There’s a never-ending list of use cases that could benefit from ML over source code and (one day) source code generation from unit tests or even natural language specifications".

— Joaquín Herrero (@joakinen) 13 de diciembre de 2017

https://t.co/s1Gr3HFGSc pic.twitter.com/6gmsMAzIhi

Neural Complete Framework

youtube.com, ML 2017 - Pascal van Kooten - Neural Complete